[paper review] MedCLIP-SAMv2: Towards Universal Text-Driven Medical Image Segmentation

BiomedCLIP fine-tuning

데이터셋 및 전처리

MedPix 데이터셋: 다양한 방사선 이미지 양식(modalities)을 포함하는 공개 데이터셋을 사용하여 모델을 학습시켰습니다. 데이터 정제: 특수 문자 제거, 공백 조정 등을 수행했으며, 정보가 너무 적은 샘플을 배제하기 위해 20자 미만의 짧은 캡션은 제외했습니다. 이미지 설정: 모든 이미지는 224×224 픽셀 크기로 조정되었으며, CLIP 모델의 표준 RGB 채널 평균 및 표준 편차를 사용하여 정규화되었습니다. 데이터 분할: 전체 데이터를 학습용 85%(20,292개), 검증용 15%(3,515개)로 나누어 사용했습니다.

성능 검증

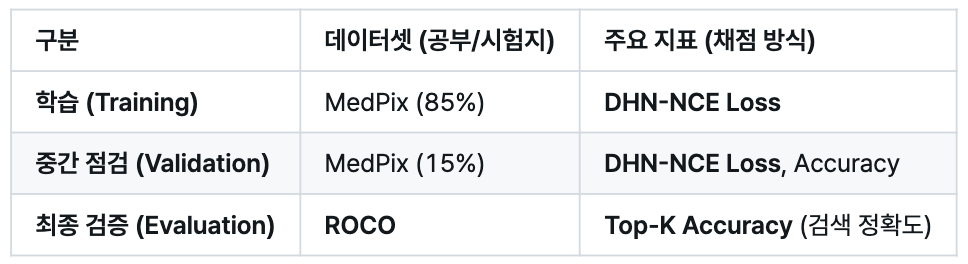

훈련셋 (Training Set: MedPix 85%)

- 사용 도구: DHN-NCE Loss (손실 함수)

- 손실 함수를 줄여가며 모델의 가중치를 업데이트 목적

내부 검증셋 (Internal Validation Set: MedPix 15%)

- 사용 지표: DHN-NCE Loss + 검색 정확도(Accuracy)

- 훈련 중에 이 데이터셋에서도 손실 함수가 잘 줄어드는지, 그리고 실제 검색 정확도가 올라가는지 확인하며 과적합 여부를 판별

외부 성능 평가 (External Evaluation: ROCO Dataset)

- 사용 지표: Top-1, Top-2 검색 정확도(Retrieval Accuracy)

- MedPix 데이터셋 외의 처음 보는 의료 데이터에서도 범용성을 확인할 목적

- 훈련이 다 끝난 후 시험 용도로 사용

왜 ROCO dataset을 검증셋으로 활용하지 않았을까?

일반화 성능(Generalization)의 증명력 약화: 이 논문의 핵심 목표는 ‘Universal(보편적인)’ 모델을 만드는 것입니다. 검증 데이터는 학습 중에 모델을 수정(하이퍼파라미터 변경 등)하는 데 참고되므로, 모델이 은연중에 그 데이터의 특성에 맞춰지게 됩니다. 하지만 ROCO를 아예 건드리지 않고 마지막에만 짠! 하고 보여주면, “우리 모델은 한 번도 본 적 없는 낯선 병원 데이터(ROCO)에서도 아주 잘 작동한다”는 것을 완벽하게 증명할 수 있습니다.

손실 함수와 성능 검증

성능 검증 용도 :

- 최적 모델 저장, 학습 도중 검증 데이터에 대해 가장 높은 점수를 얻은 모델 가중치를 따로 저장함

- 과적합 방지 및 조기 종료, 학습 데이터에 대한 손실 함수는 계속 낮아지는데 검증 데이터에 대한 성능 점수가 더 이상 오르지 않는다면 학습을 강제로 중단해 범용성을 확보할 수 있음

- 검증 점수가 한동안 정체된다면 학습 속도를 낮추어 세밀한 학습을 유도할 수 있음

- 성능 검증을 통해 배치 크기나 손실 함수 파라미터를 실험해볼 수 있음, 그 중 성능 검증 점수가 가장 높게 나오는 설정을 찾아 최종 학습 설정을 확정지음

Radiology Objects in COntext (ROCO) 데이터셋은 다양한 방사선 이미지를 포함하고 있어 의료 도메인의 일반화 능력을 평가, 즉 범용적 의료파운 데이션 모델로서 가치를 확인하는데 적합하다. CLIP의 정렬 능력 자체를 평가하기 위함